Índice de contenidos

¿Qué son los algoritmos de caja negra?

Un algoritmo de caja negra es un modelo cuyo proceso interno no es transparente para la persona usuaria o el evaluador. Observamos entradas (features) y salidas (predicciones), podemos medir su rendimiento y desplegarlo en producción, pero no es directo entender cómo combina las variables para producir cada resultado. Suelen ser modelos complejos (p. ej., ensembles grandes o redes neuronales profundas) o propietarios (cerrados por negocio) que priorizan precisión sobre interpretabilidad nativa.

En muchos proyectos de datos buscamos modelos que acierten mucho en contextos complejos: muchas variables, relaciones no lineales y señales sutiles. Ahí brillan los llamados algoritmos de “caja negra”: ofrecen gran rendimiento, pero sacrifican claridad sobre cómo llegan a cada decisión. Esto plantea retos de confianza, auditoría y cumplimiento: no basta con que el modelo funcione; a menudo debemos explicarlo, vigilarlo y documentarlo.

Google un ejemplo de algoritmo de caja negra

Google (parte de Alphabet) opera productos con miles de millones de usuarios: Búsqueda, YouTube, Maps, Android, Chrome, Gmail, Google Ads, Cloud, etc. En la mayoría de ellos se apoyan modelos de aprendizaje automático para clasificar, recomendar, detectar spam/fraude y fijar pujas. Muchos de estos modelos son caja negra para el público: conocemos entradas y salidas, pero no la lógica interna exacta.

Dónde usa Google modelos “caja negra”

- Búsqueda (ranking): fusiona cientos/miles de señales y modelos (incl. deep learning) para ordenar resultados y generar fragmentos/funciones.

- Google Ads (subastas y Smart Bidding): ajusta pujas por impresión según objetivo (tCPA, tROAS, Max Conv/Value) con señales de contexto.

- YouTube (recomendaciones): predice probabilidad de ver, retener, clicar y satisfacer al usuario.

- Gmail (spam/phishing/malware): modelos que filtran correos maliciosos.

- Maps (ETA/rutas): predicción de tiempos/afluencia/alternativas.

- Fotos/Translate/Assistant: visión y lenguaje con redes neuronales a gran escala.

Por qué son “caja negra”

- Complejidad y escala: arquitecturas profundas y ensembles difíciles de interpretar.

- Propiedad y seguridad: detalles internos no se publican por ventaja competitiva y para evitar manipulación.

- Datos dinámicos: los modelos se actualizan y reentrenan constantemente.

Ejemplos de algoritmos de caja negra que ya están tomando decisiones por ti

1) IA en selección: tu CV lo evalúa un algoritmo antes que una persona

Muchas empresas usan ATS (Applicant Tracking Systems) para cribar cientos o miles de candidaturas. En EEUU, buena parte de las solicitudes se filtran antes de que un reclutador las vea.

Por qué se usa: Ahorra tiempo y costes en contratación.

Riesgos: Falta de transparencia y posible sesgo (los algoritmos aprenden de historiales con prejuicios).

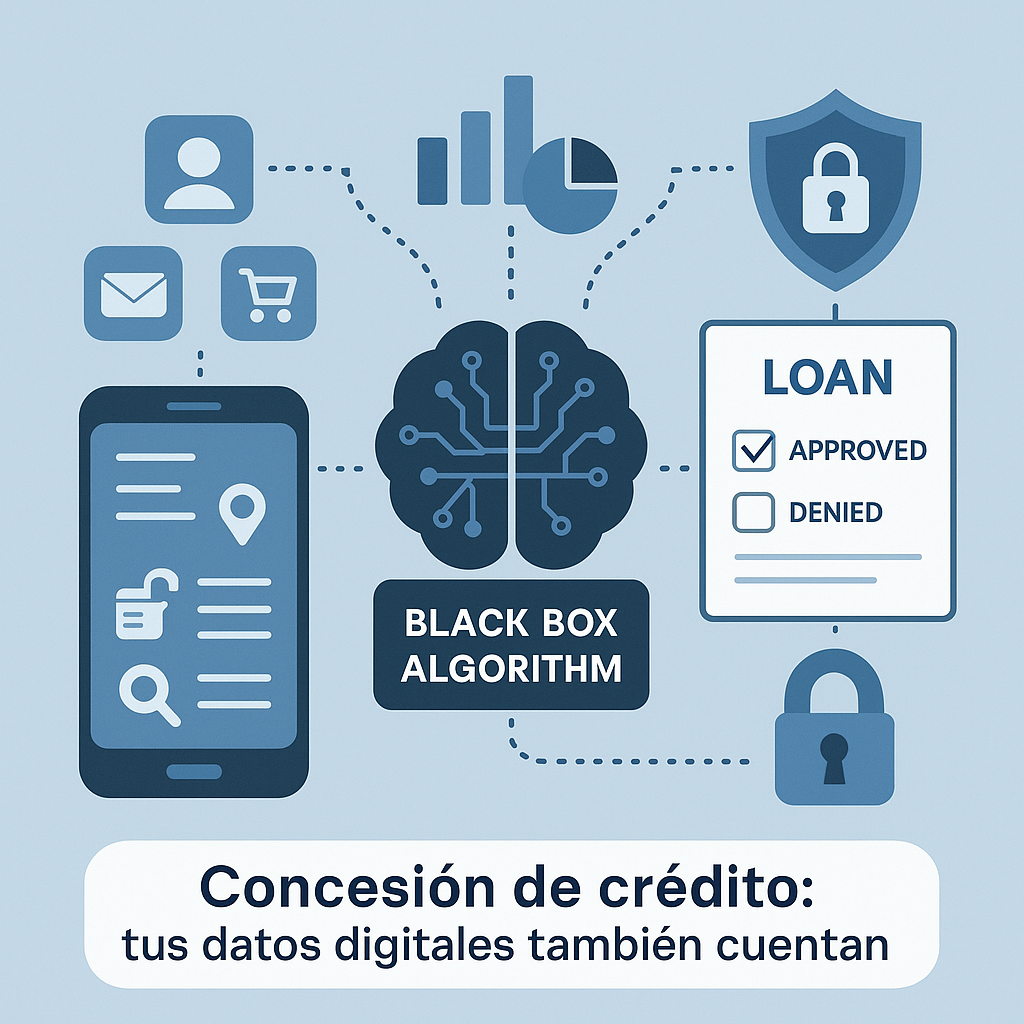

2) Concesión de crédito: tus datos digitales también cuentan

La evaluación de un préstamo ya no se limita al score crediticio; algunos modelos incorporan patrones de compra, búsquedas y hasta señales de redes sociales.

Por qué se usa: Ampliar información para predecir riesgo con más precisión.

Riesgos: Privacidad, consentimiento difuso y opacidad en los criterios.

3) Apps de citas: el “algoritmo del match” no siempre es neutro

Plataformas de dating ajustan perfiles y rankings con modelos que optimizan “éxito” (engagement, matches). Algunas han modificado perfiles para hacerlos “más atractivos”; otras calculan puntuaciones de deseabilidad no públicas.

Por qué se usa: Mejorar emparejamientos y retención.

Riesgos: Falta de claridad sobre cómo se prioriza a cada persona; posible distorsión de preferencias.

4) Salud y seguros: detectar adicciones… y decidir coberturas

Proyectos de datos en salud utilizan modelos predictivos con cientos de variables para detectar riesgo de abuso (p. ej., opioides) y anticipar costes sanitarios.

Beneficio potencial: Prevención y uso más eficiente de recursos.

Riesgos: Uso de datos sensibles (historial clínico, dirección), estigmatización y decisiones de cobertura opacas.

5) Justicia: algoritmos de riesgo que influyen en sentencias

Herramientas como COMPAS estiman riesgo de reincidencia y ya se han usado para apoyar decisiones judiciales.

Beneficio potencial: Estandarizar criterios y agilizar valoraciones.

Riesgos: Opacidad del modelo, posible discriminación (diferencias por raza/género) y dificultad para impugnar la puntuación.