¿Por qué la mayoría de los agentes de inteligencia artificial colapsan cuando salen del laboratorio? No es por falta de datos ni de algoritmos brillantes. Es por diseño. O mejor dicho, por la falta de un diseño inteligente. En este artículo, vamos a contarte cómo se construyen agentes de IA de verdad: autónomos, robustos y, sobre todo, útiles.

Tal vez te interese: cómo elegir la mejor formación en IA

Índice de contenidos

Cuando un Agente no es solo Código

El término «agente» suena técnico, pero aquí hablamos de algo muy real: sistemas que toman decisiones, actúan y aprenden por sí solos. Desde tu asistente de voz hasta los bots que gestionan millones en bolsa. Pero ojo, la mayoría no está lista para el mundo real. Nosotros lo sabemos y por eso te proponemos un enfoque radicalmente distinto: agentes atómicos, diseñados como piezas de LEGO que se combinan con precisión quirúrgica.

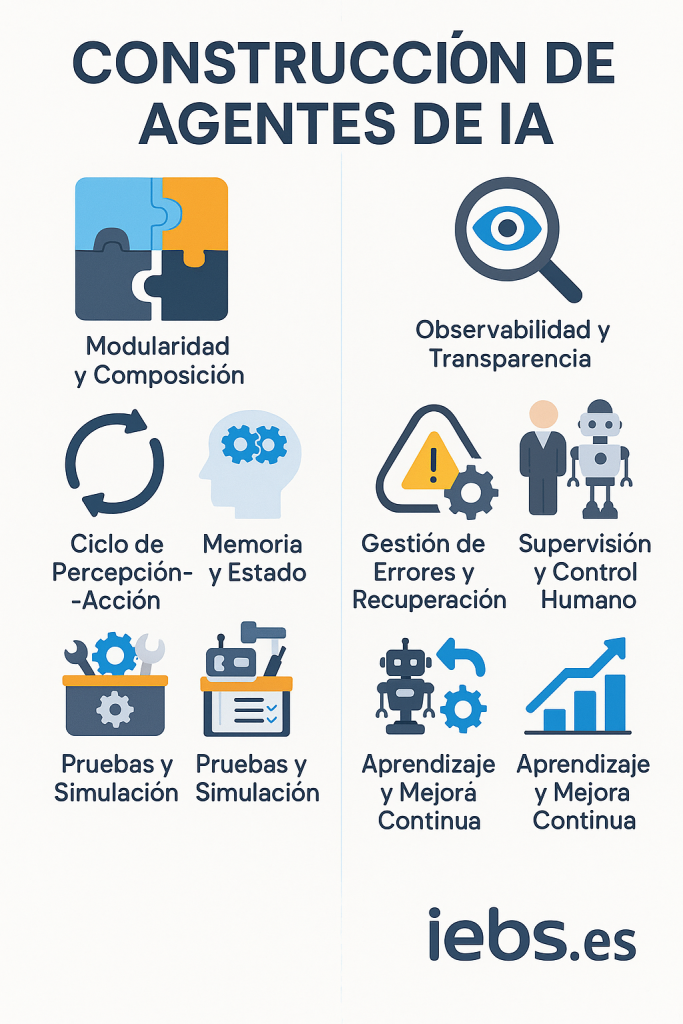

Modularidad: No construyas un Frankenstein

¿Has intentado actualizar una app monolítica? Es como cambiar el motor de un avión en pleno vuelo. Por eso, la modularidad no es una moda, es supervivencia. Dividir un agente en componentes independientes (percepción, razonamiento, acción, memoria, herramientas) permite escalar, depurar y evolucionar sin colapsar el sistema entero. Modular no es opcional, es estratégico.

Un Cerebro que Aprende con el Tiempo

Un buen agente no se reinicia cada mañana. Recuerda, acumula experiencias, y sobre todo, aprende. Incorporar memoria y estado interno permite coherencia en las acciones, continuidad en las conversaciones y una adaptación profunda a tareas largas o repetitivas. ¿Te imaginas un terapeuta sin memoria? Pues eso.

Percepción, Acción, Reacción

En el corazón del diseño está el bucle de percepción-acción. Los mejores agentes no actúan al azar: observan su entorno, evalúan opciones y responden en ciclos cada vez más afinados. Este mecanismo convierte datos en decisiones, y decisiones en acción inteligente. Como en la vida real, adaptarse o morir.

Herramientas Externas: Deja que Google trabaje para ti

¿Para qué reinventar la rueda cuando puedes usar una API? Los agentes modernos deben ser capaces de consultar bases de datos, acceder a sistemas externos o delegar tareas complejas a servicios especializados. La integración de herramientas no es un lujo, es la vía para ampliar sus límites naturales.

Simulación: El Laboratorio de la Resiliencia

Antes de lanzarlo al mundo, un agente debe sobrevivir a su entrenamiento. Simular escenarios reales, estresar sus decisiones y anticipar fallos es la única forma de garantizar que funcione fuera del PowerPoint. Los buenos agentes se templaron en el fuego del testeo riguroso.

Transparencia: Ver para confiar

Si un sistema decide por ti, más vale que entiendas cómo y por qué. La observabilidad —monitorear decisiones, registrar rutas de razonamiento— no solo mejora la confianza, también acelera la depuración y fomenta la mejora continua. Sin visibilidad, no hay IA responsable.

Supervisión Humana: El Botón Rojo siempre debe existir

La autonomía está bien… hasta que no lo está. Todo agente debe tener mecanismos para ceder el control en situaciones críticas. Porque la inteligencia artificial puede ser muy lista, pero todavía no entiende de ética, consecuencias o sentido común. Ahí entramos nosotros.

Errores Inteligentes: Fallar no es el Fin

No se trata de evitar los errores, sino de diseñar agentes que aprendan de ellos. Mecanismos de recuperación, alertas proactivas y rutinas de autodiagnóstico son la diferencia entre un fallo puntual y un colapso total. En IA, como en medicina, prevenir salva más que curar.

Cuando los Agentes se multiplican

En sistemas donde varios agentes interactúan —como flotas de robots o redes de asistentes— la coordinación es vital. Protocolos claros, comunicación eficaz y gestión de conflictos marcan la diferencia entre colaboración y caos. El multiagente es el futuro, pero necesita reglas.

Aprender o Morir

Los entornos cambian. Rápido. Solo los agentes con capacidades de aprendizaje continuo pueden seguir siendo relevantes. Esto no es opcional: es lo que separa a los sistemas vivos de los obsoletos. La IA que no aprende, muere y está claro que no es lo que queremos.

Los agentes del futuro se tienen que diseñar como ecosistemas vivos. Módulos inteligentes, herramientas externas, memoria persistente, supervisión humana y aprendizaje constante. Esa es la receta. ¿Estás construyendo sistemas para que simplemente funcionen… o para que transformen el mundo?

Si te ha gustado este artículo, tal vez estés considerando ampliar tu formación. Descubre la mayor oferta formativa del mundo digital en IEBS, donde aprenderás a crear agentes que realmente piensen.